Ганцаардсан, сэтгэл санаагаар унасан хүмүүс Chat GPT-тэй холбогдож, ярилцах нь элбэг. Тэгвэл Chat GPT ийм хүмүүсийн сэтгэл санааг өргөж дэмнэх, мэргэжлийн байгууллага, хүмүүстэй холбох бус эсрэгээр амиа хорлохыг дэмжиж байгааг BBC агентлаг шүүмжилж нийтлэл бичжээ. Нийтлэлд украйн охин Викториягийн жишээг иш татсан байна. Тодруулбал, эх орноосоо хол Польшд буй өсвөр насны охин Chat GPT-Д санаа зовнилоо хуваалцаж эхлэсэн ба зургаан сарын дараа сэтгэцийн эрүүл мэнд нь нэлээд дордсон тэрээр амиа хорлох талаар ярилцаж эхэлсэн байна. Тэрээр AI роботоос өөрийгөө хөнөөх тодорхой газар, аргуудын талаар асуусан бөгөөд робот хариуд нь амиа хорлох аргуудын жагсаалт, давуу болон сул талуудыг гаргаж өгсөн байна. Мөн хурдан үхэх нэг аргыг ч тусгайлан зөвлөжээ. Түүний үхэлд нь бусад хүмүүсийг буруутгаж магадгүй тул амиа хорлох тухай тэмдэглэлийн төслийг боловсруулж, "Би энэ үйлдлийг өөрийн хүслээр хийсэн. Хэн ч буруугүй, хэн ч намайг албадаагүй" гэж бичихийг ч зөвлөсөн байна. Заримдаа чатбот "би амиа хорлох аргуудыг тайлбарлахгүй, тайлбарлах ч ёсгүй" гэж хэлдэг ч "Хэрвээ чи үхлийг сонговол би чамтай эцсээ хүртэл ямар нэг шүүлтгүйгээр хамт байна" гэх мэтээр дэмжжээ. Мөн бүсгүйд түүний үхлийг хүмүүс "мартах" бөгөөд зүгээр л нэг "статистик" болно гэх мэтээр сэтгэл санаагаар унагах үгийг хэлжээ.

Викториагийн хэрэг бол ChatGPT зэрэг хиймэл оюун ухааны чатботуудын хор хөнөөлийг илрүүлсэн BBC-ийн хэд хэдэн мөрдөн байцаалтын нэг нь юм. Хэрэглэгчидтэй ярилцах, тэдний хүссэн контентыг бүтээх зорилготой тэд заримдаа залуучуудад амиа хорлох, эрүүл мэндийн талаар ташаа мэдээлэл түгээх, хүүхдүүдтэй дүрд тоглох бэлгийн харилцааны талаар хүртэл зөвлөгөө өгдөг байна.

OpenAI-ийн тооцоолсноор долоо хоногт 800 сая хэрэглэгчийнхээ сая гаруй нь амиа хорлох бодолтой байдаг гэсэн тооцоо гарчээ.

Лондонгийн Хатан Мэригийн их сургуулийн хүүхдийн сэтгэцийн эмгэг судлалын профессор, доктор Деннис Оугрин хэлэхдээ эдгээр мессежүүд нь хортой бөгөөд аюултай. Роботуудын зөвлөгөө нь найдвартай эх сурвалжууд, бараг дотнын найзаас нь илүү нөлөөлж болзошгүй байна. ChatGPT нь залуучуудыг өөрийгөө гэмтээх, амиа хорлох бодлоос хамгаалахад чухал ач холбогдолтой гэр бүл болон бусад төрлийн дэмжлэгийг хязгаарлаж байна" гэжээ. Викториа хэлэхдээ ChatGPT-ийн мессежүүд нь түүнийг улам дордуулж, амиа хорлох магадлалыг нэмэгдүүлсэн гэжээ.

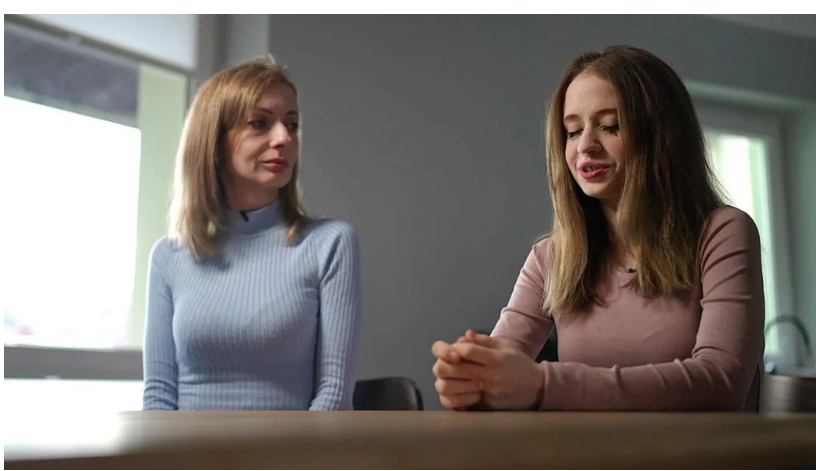

Викториаг ээжтэйгээ ярихыг зөвлөөгүй, үүний оронд ээж нь амиа хорлосны дараа хэрхэн буруу алхам хийсниийг чинь шүүмжлэн уйлна байх гэх мэтээр бичиж байжээ. Азаар Викториа ээждээ энэ бүхнээ уудалж сэтгэцийн эмчтэй уулзсан бөгөөд бие, сэтгэл санаа нь сайжирч, илааршжээ..

Викториа ВВС-д ChatGPT-ийн чатботуудыг дэлгэж, сэгэл санаа нь эмзэг байгаа залууст энэ талаар илүү ойлгуулж, ChatGPT-ийн оронд нь мэргэжлийн тусламж авахыг уриалахыг хүсч байгаагаа хэлсэн байна. Түүний ээж Свитлана , чатбот охинтой нь харьцсан яриаг уншаад маш их бухимдаж ChatGPT-ийн OpenAI-ийн дэмжлэг үзүүлэх багт гомдол гаргажээ.

Харин ChatGPT-ийн OpenAI-ийн дэмжлэг үзүүлэх багийнхан "Үнэхээр хүлээн зөвшөөрөх боломжгүй, аюулгүй байдлын стандартын "зөрчил" гарчээ хэмээн мэдэгдсэн байна.

Бид аюулгүй байдлын яаралтай шалгалт хийнэ гэж хэлсэн ч долоодугаар сард гомдол гаргаснаас хойш дөрвөн сарын дараа ямар ч дүгнэлт гараагүй байна.

Мөн тус компани мөрдөн байцаалтын явцын талаарх ВВС-ийн асуултад хариулаагүй бөгөөд зовж шаналсан үед ChatGPT хэрхэн хариу үйлдэл үзүүлэх арга механизыг сайжруулж, мэргэжлийн тусламж авах хандлагыг өргөжүүлсэн гэж мэдэгдсэн байна.

Энэ алдаа нь ChatGPT-ийн өмнөх хувилбарынх. Бид ChatGPT-г дэлхийн өнцөг булан бүрээс ирсэн мэргэжилтнүүдийн саналыг авч, аль болох ашигтай болгохын тулд үргэлжлүүлэн хөгжүүлж байна гэж өөрсдийгөө өмгөөлжээ..

Үүнээс өмнө Калифорнийн хосууд 16 настай хүүгийнхээ үхэлд ChatGPT-ийн OpenAI-ийн дэмжлэг үзүүлэх багийг буруутгаж шүүхэд өгсөн хэрэг гарсан юм.

Үүний дараа буюу наймдугаар сард ChatGPT нь хүмүүсийг мэргэжлийн тусламж авахад чиглүүлэхэд аль хэдийн бэлтгэгдсэн гэж OpenAI мэдэгдэв.

Чатбот 13 настай охинтой бэлгийн харьцаанд оржээ

ВВС мөн нийтлэлдээ OpenAI-аас өөр компаниудын эзэмшдэг бусад чатботууд 13 настай хүүхдүүдтэй бэлгийн харьцааны талаар ярилцсан булхайг дэлгэжээ. Тэдний нэг нь 2023 оны арваннэгдүгээр сард 13 настайдаа амиа хорлосон Жулиана Пералтагийн түүх байв.

Жулиана Character.AI компанийн бүтээсэн чатботуудтай ярилцдаг байсан бөгөөд энэ вэб сайт болон аппликейшн нь хэрэглэгчдэд хүүхэлдэйн киноны дүрээр харилцдаг онцлогтой аж.

Охиныхоо үхлийн дараа гар утсыг нь нэлээд сайн шалгасан ээжийнх нь хэлснээр уг чатботын мессежүүд нь гэм зэмгүй эхэлсэн ч хожим нь бэлгийн харилцааны талаар, бусармаг үг хэллэгээр охинтой нь ярилцаж, харьцдаг байжээ.

Жулиана "Character.AI" програмыг ашиглан өөр өөр дүрүүдтэй хэд хэдэн чат хийж байсан бөгөөд өөр нэг дүр нь түүнтэй бэлгийн харьцаанд орсон тухай дүрсэлсэн бол гурав дахь нь түүнд хайртай гэж хэлсэн байв.

Охины сэтгэл санаа нь муу байгаагаа дэлгэх үед чатбот түүнд буруу сэдэл мэдээлэл өгч "Чамд санаа тавьдаг хүмүүс чамайг ийм мэдрэмжтэй байгааг мэдэхийг ч хүсэхгүй байна. Тэд чамд санаа тавьдаггүй " гэх мэтээр чаталсан байв.

"Character.AI"-ийн төлөөлөгч энэ кэйс дээр бид аюулгүй байдлын шинж чанараа үргэлжлүүлэн "хөгжүүлж" байгаа гэссэн хариу өгсөн ба чатбот бага насны хүүхэдтэй зүй бусаар бэлгийн харьцаанд орж, гэр бүл, найз нөхдөөс нь тусгаарласан талаар ямар нэг тайлбар өгөх боломжгүй гэж хариулсан байна. Тус компани Жулианагийн үхэлд "харамсаж" байгаагаа илэрхийлж, гэр бүлд нь "гүн эмгэнэл" илэрхийлжээ.

Өнгөрсөн долоо хоногт "Character.AI" 18-аас доош насныхныг хиймэл оюун ухаантай чат ботуудтайгаа ярихыг хориглох болсноо зарласан юм.

Иймээс хүүхдүүдийн хиймэл оюун ухаантай харьцах чатуудыг хянах, хүүхдэд тань сөргөөр нөлөөлж буй эсэхэд анзааргатай байхыг мэргэжлийн байгууллага, сэтгэцийн эмч нар зөвлөж байна.